DeepSeek的新聊天机器人拥有令人印象深刻的介绍:“嗨,我被创建了,您可以问任何东西,并得到一个甚至可能让您感到惊讶的答案。”这种AI是中国初创公司DeepSeek的产物,已迅速成为主要市场参与者,甚至导致NVIDIA的股价大幅下降。

图片:ensigame.com

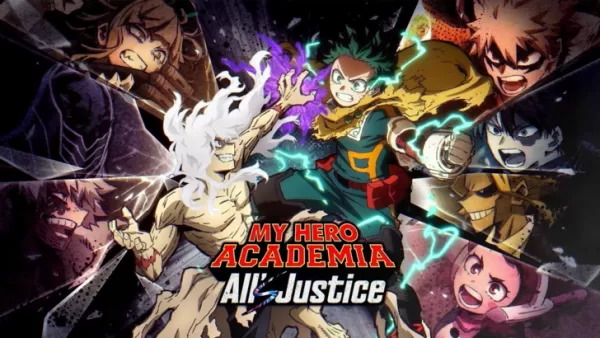

图片:ensigame.comDeepSeek的竞争优势在于其创新的建筑和培训方法。关键技术包括:

- 多语预测(MTP): MTP不是单独预测单词,而是同时预测多个单词,从而提高准确性和效率。

- 专家的混合物(MOE):该体系结构使用多个神经网络,加速培训并提高性能。 DeepSeek V3使用256个网络,每个令牌都激活了8个网络。

- 多头潜在注意力(MLA): MLA反复致力于至关重要的句子部分,从而最大程度地减少了忽略重要信息的风险。

DeepSeek最初声称使用2048 GPU培训了其强大的DeepSeek V3神经网络,仅需600万美元。然而,半分析显示出更大的基础设施:大约50,000个NVIDIA HOPPER GPU,包括10,000 H800,10,000 H100和其他H20,分布在多个数据中心。这代表了一笔总额约16亿美元的服务器投资,运营费用估计为9.44亿美元。

图片:ensigame.com

图片:ensigame.comDeepSeek是中国对冲基金高飞行员的子公司拥有其数据中心,提供了对优化和创新实施的无与伦比的控制。这种自资助的方法促进了敏捷性和快速决策。该公司还吸引了顶尖人才,一些研究人员每年收入超过130万美元,主要来自中国大学。

图片:ensigame.com

图片:ensigame.comDeepSeek最初的600万美元培训成本索赔具有误导性;它仅反映了训练前的GPU使用情况,不包括研究,改进,数据处理和基础架构。该公司对AI开发的总投资超过5亿美元。尽管进行了大量投资,但其精益结构允许有效的创新实施。

图片:ensigame.com

图片:ensigame.comDeepSeek的成功展示了资金充足的独立AI公司与行业巨头竞争的潜力。但是,其成就归因于数十亿美元的投资,技术突破和强大的团队,而不是革命性的预算。即便如此,DeepSeek的成本仍大大低于竞争对手。例如,DeepSeek在R1上花费了500万美元,而Chatgpt的Chatgpt4o $ 1亿美元。尽管初始索赔夸大了,但这凸显了巨大的成本优势。